- Собственная информация

-

Собственная информация — статистическая функция дискретной случайной величины.

Собственная информация сама является случайной величиной, которую следует отличать от её среднего значения — информационной энтропии.

Для случайной величины

, имеющей конечное число значений:

, имеющей конечное число значений:собственная информация определяется как

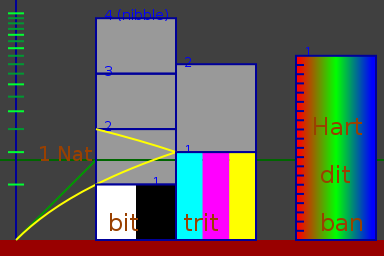

Единицы измерения информации зависят от основания логарифма. В случае логарифма с основанием 2 единицей измерения является бит, если используется натуральный логарифм — то нат, если десятичный — то хартли.

Основание логарифма Единица измерения Количество информации

о падении монеты «орлом» вверх2 бит  бит

битe нат  ната

ната10 хартли  хартли

хартлиСобственную информацию можно понимать как «меру неожиданности» события — чем меньше вероятность события, тем больше информации оно содержит.

Свойства собственной информации

1) Неотрицательность:

.

.  при

при  , т.е. предопределенный факт никакой информации не несет.

, т.е. предопределенный факт никакой информации не несет.2) Монотонность:

, если

, если  .

.3) Аддитивность: для независимых

справедливо

справедливо .

.См. также

Литература

- Габидулин, Э. М., Пилипчук, Н. И. Лекции по теории информации. — М.: МФТИ, 2007. — 214 с. — ISBN 5-7417-0197-3

Категория:

Категория:- Теория информации

-

Wikimedia Foundation. 2010.